项目简介

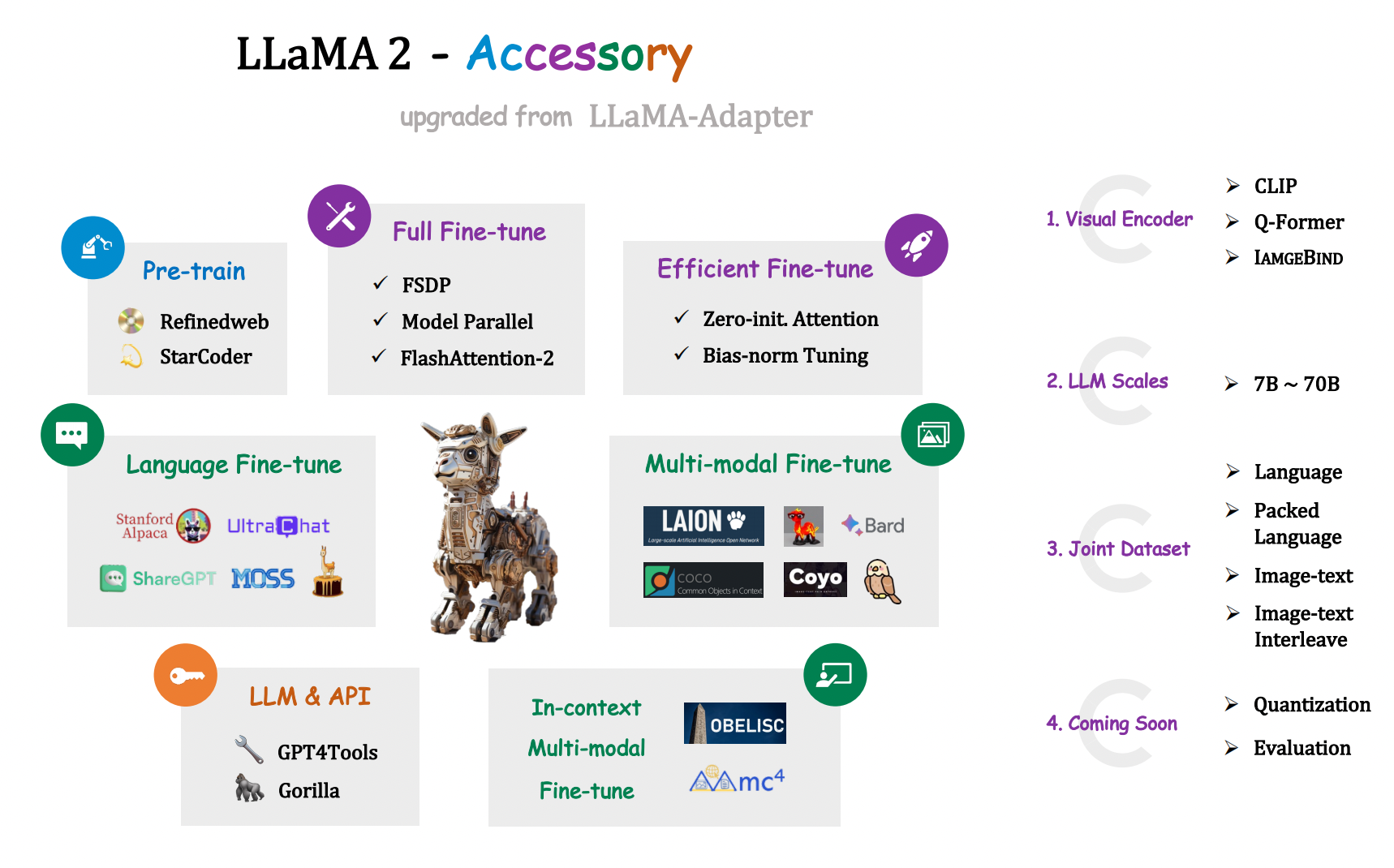

LLaMA2-Accessory 是一个开源工具包,用于大型语言模型 (LLM) 和多模式 LLM 的预训练、微调和部署。这个 repo 主要继承自 LLaMA-Adapter,具有更高级的功能。

特征

支持更多数据集和任务

- 使用 RefinedWeb 和 StarCoder 进行预训练。

- 使用 Alpaca、ShareGPT、LIMA、UltraChat 和 MOSS 进行单模式微调。

- 使用图像文本对(LAION、COYO 等)、交错图像文本数据(MMC4 和 OBELISC)和视觉指令数据(LLaVA、Shrika、Bard)进行多模态微调

- API 控制LLM(GPT4Tools 和 Gorilla)。

高效优化和部署

- 通过零初始注意和偏差范数调整进行参数高效的微调。

- 完全分片数据并行 (FSDP)、Flash Attention 2 和 QLoRA。

支持更多视觉编码器和 LLMs

- 视觉编码器:CLIP、Q-Former 和 ImageBind。

- LLMs:LLaMA 和 LLaMA2。